Приветствую!

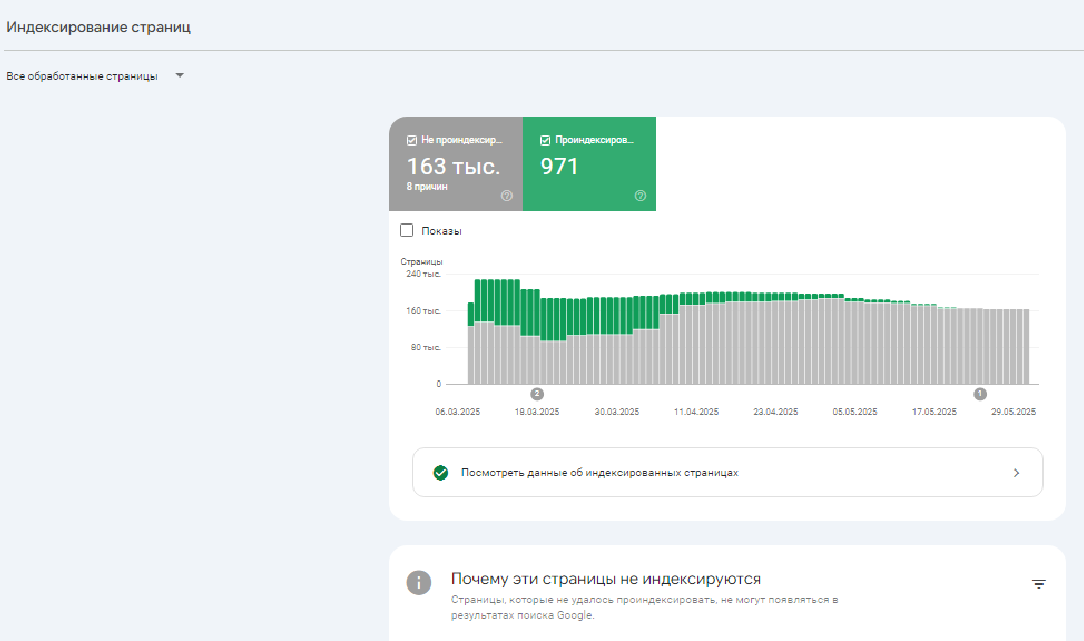

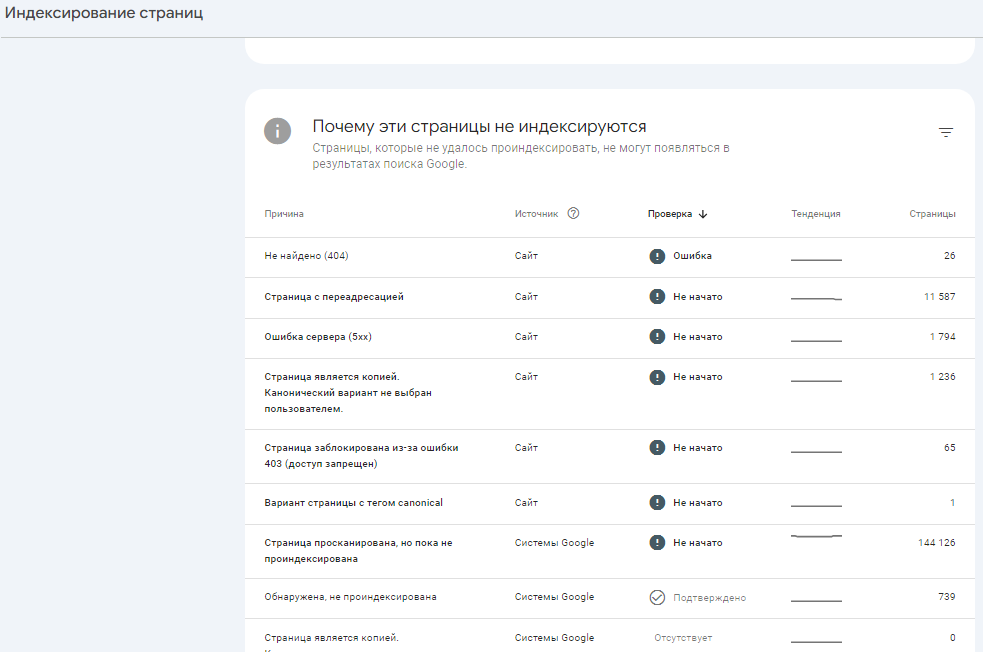

Гугл проиндексировал сайт и по итогу обнаружил 160000 страниц. Хотя на сайте 1200 карточек товара. Множество запросов от Гугла и Яндекса которые забивают за день весь хостинг, после чего приходится чистить кэш. Есть предположение что гугл использует просто всевозможные варианты фильтров. Может кто сталкивался?

Содержимое сайта публикуется на условиях CreativeCommons Attribution-ShareAlike 3.0 или более поздней версии. Программные коды в тексте статей — на условиях GNU GPL v2 или более поздней версии.

Документация по совместной работе с репозиторием drupal.ru – https://docs.drupal.ru/code

Drupal – торговая марка Дриса Бёйтарта

12+

Комментарии

А тут не нужно предполагать, а нужно прямо в том же Google Search Console посмотреть примеры адресов, которые он сканирует, понять, что это за адреса и настроить файл robots.txt так, чтобы нежелательные адреса не сканировались.

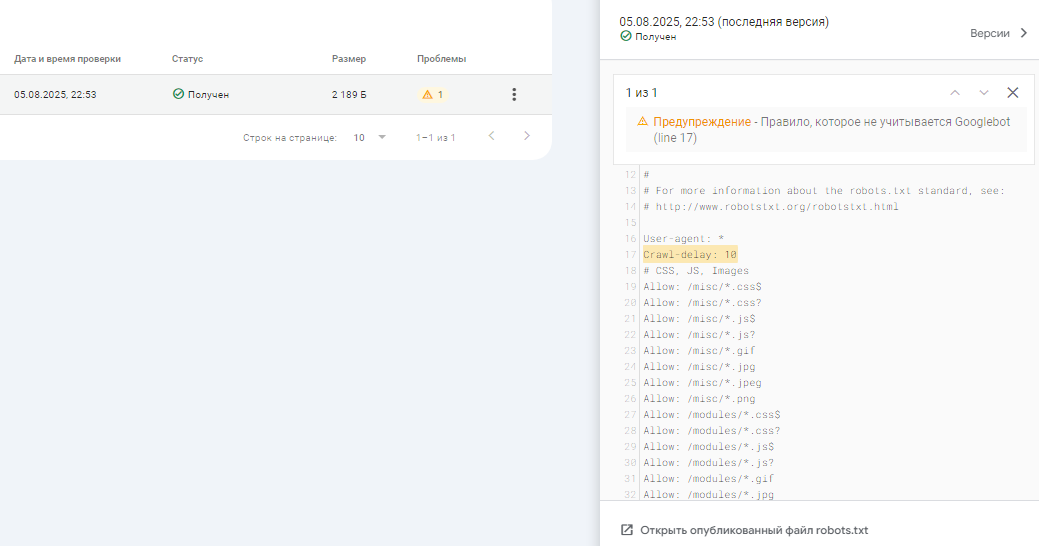

Спасибо! Какое то еще предупреждение появилось, только сегодня заметил.